Hoy quería hablarte sobre la evolución de los modelos de lenguaje de gran escala o LLMs.

¿Qué son los Modelos de Lenguaje de Gran Escala (LLMs)?

Por si acaso no sabes lo que es un LLM, la tecnología detrás del modelo de lenguaje de ChatGPT, Gemini, Claude, Llama…son LLMs. Modelos de lenguaje de gran escala.

En otras palabras, son programas informáticos gurdus gurdus, que se han nutrido de enormes cantidades de texto (en su mayoría de internet) y han aprendido a generar textos muy coherentes.

Recordatorio: coherente no quiere decir, veraz.

“Las vacas son capaces de comer camiones enteros»

es una frase coherente desde el punto de vista lingüístico, pero no es una frase verídica.

Desentrañando los LLMs con un diagrama muy interesante.

Continúo y para eso, quiero apoyarme en esta imagen. Al final del artículo te cuento por qué me gusta este diagrama.

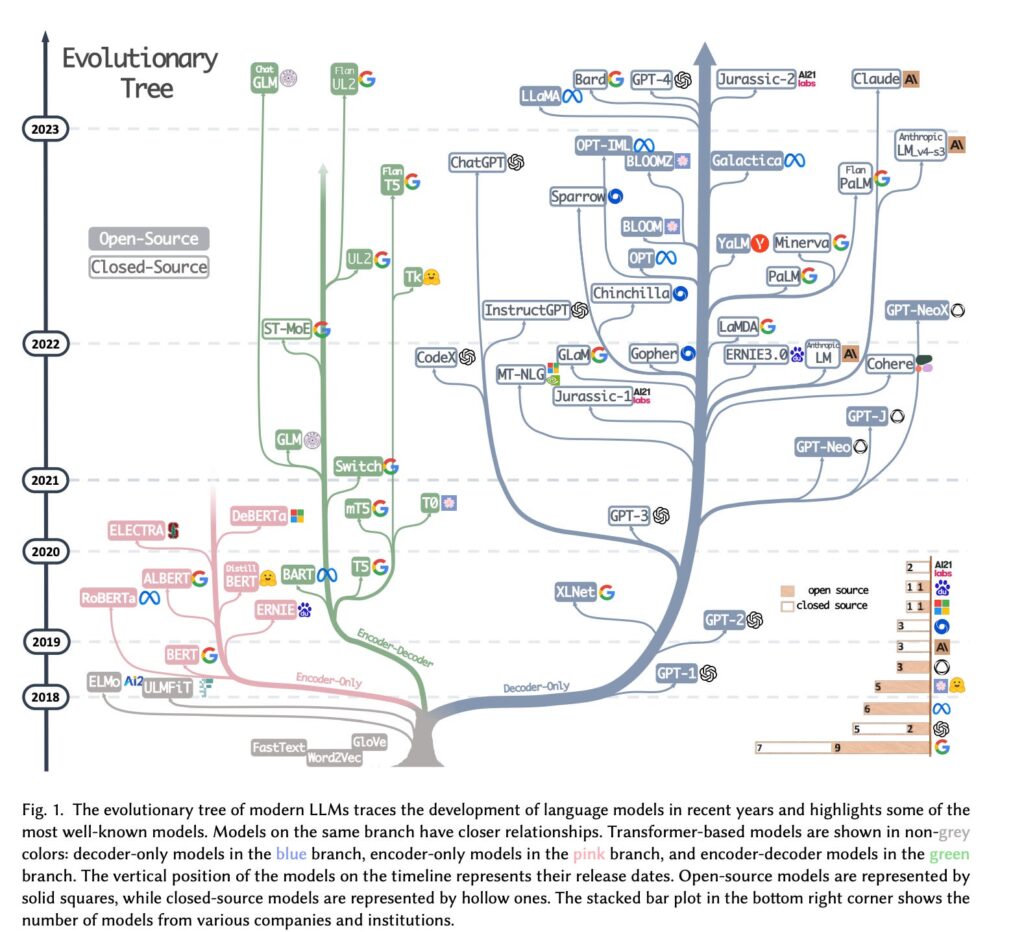

En este diagrama podemos ver la evolución de este tipo de modelos desde principios de 2018 hasta la actualidad.

La imagen también muestra qué modelos son open source, y cuáles no.

Que los LLMs sean cerrados significa que no tenemos los detalles de cómo han sido construidos y, por tanto, es poco probable que se puedan reproducir.

Otro de los detalles más interesantes que podemos observar es la cantidad de modelos que se han ido desarrollando en función de cada arquitectura de transformer y, a la vista está que la arquitectura decoder-only es una de ramas que más ha evolucionado.

De hecho, OpenAI fue la empresa que empezó a implementar modelos con el decoder-only, con la primera versión de GPT, el GPT-1.

Y como dirían en los relatos épicos…el resto ya es historia.

Para ir terminando, te cuento por qué me gusta tanto esta imagen.

Como representar en un diagrama múltiples variables de manera atractiva

Este gráfico representa al menos siete variables distintas relacionadas con la evolución de los modelos de lenguaje a lo largo del tiempo:

1. Fecha de lanzamiento: indicada por la posición vertical de los modelos a lo largo de la línea de tiempo, que se extiende desde 2018 hasta 2023.

2. Tipología del modelo: representada por las ramas de colores en las que se sitúan los modelos. Los colores indican si son modelos de solo codificación (encoder-only), solo decodificación (decoder-only), o modelos de codificación-decodificación (encoder-decoder).

3. Código abierto vs. Código cerrado: diferenciado por las formas de los íconos de los modelos; los modelos de código abierto están representados por cuadrados sólidos y los modelos de código cerrado por íconos huecos.

4. Relaciones entre modelos: indicadas por las líneas que conectan los modelos. Las líneas cercanas o bifurcaciones sugieren una relación o evolución de un modelo a otro.

5. Cantidad de modelos por empresa: representado por el gráfico de barras apiladas en la esquina inferior derecha, que muestra el número de modelos de diferentes empresas e instituciones.

6. Empresa o institución desarrolladora: Indicado por los logotipos junto a cada modelo, mostrando qué compañía o institución desarrolló cada modelo.

7. Transformers y otros modelos: La distinción entre modelos basados en transformers y otros tipos de modelos.

Si quieres más, tienes una mejor opción que este blog. Ojo, no digo que este blog sea una mala opción, no me malinterpretes.

Con los artículos de mi blog puedes aprender sobre inteligencia artificial, análisis de datos, ventas o el mundo de la empresa.

Y voy a parar de decir cosas para que sea creíble, pero habría más. De verdad.

Lo que digo es que si quieres contenido exclusivo y enterarte de otra serie de cosas te puedes suscribir a mi boletín de correo gratuito.

¿Cómo? Dejando tu correo aquí abajo:

Recibe los correos.

Chao.