La inteligencia artificial (IA) se ha convertido en una herramienta increíble, capaz de hacer cosas que antes solo veíamos en películas de ciencia ficción. Sin embargo, como toda tecnología, también tiene un lado oscuro. Deepfakes y desinformación se han convertido en una combinación cada vez más preocupante, ya que estas herramientas permiten crear contenido falso para engañar, manipular o desinformar.

En este artículo, te cuento qué son los deepfakes, los tipos que existen y cómo pueden usarse tanto para fines maliciosos como, a veces, inofensivos.

¿Qué es un Deepfake?

Un deepfake es contenido generado por IA que reemplaza el rostro, la voz o el estilo de una persona para hacer que parezca que está haciendo o diciendo algo que en realidad nunca hizo o dijo. El término viene de «deep learning» (aprendizaje profundo) y «fake» (falso). Esta tecnología se utiliza para manipular videos, imágenes, audios o incluso textos, generando un contenido tan realista que puede ser difícil distinguirlo de lo auténtico.

Tipos de Contenido Generado por IA

Audio: Clonación de voz.

Herramientas: Eleven Labs, Suno. Estas herramientas permiten clonar la voz de una persona y hacer que diga cualquier cosa. En un futuro muy cercano, con herramientas como Suno se podrían crear canciones con el timbre de cualquier persona.

Así como existen ejemplos de clonación de voz para estafar (normalmente para conseguir dinero), es importante tomar medidas preventivas para protegernos.

Por ejemplo, tener una palabra secreta: Solo nuestros familiares o personas cercanas deberían conocerla, y puede ser una forma efectiva de evitar caer en estafas si alguien intenta suplantarnos pidiendo dinero.

Por otro lado, podemos verlo desde un punto de vista más positivo. A mí me haría mucha ilusión que se recuperara la voz de Constantino Romero, un conocido locutor, y poder utilizarla en películas de dibujos animados, o doblando películas.

Video: Manipulación visual y deepfakes.

Herramientas: DeepFaceLab, Heygen, Vidnoz, SwapFace. Estas herramientas permiten cambiar rostros en videos, crear escenas que nunca existieron o incluso resucitar digitalmente a actores como Carrie Fisher en Star Wars o la actriz Lola Flores en un conocido anuncio de cerveza.

- DeepFaceLab: Una herramienta de código abierto que permite cambiar rostros en videos mediante técnicas avanzadas de aprendizaje profundo. Es una de las opciones más populares para crear deepfakes.

- Heygen: Anteriormente conocida como Movio, esta herramienta permite crear avatares realistas que pueden hablar diferentes idiomas, generando videos para aplicaciones comerciales y de entretenimiento. LipSync.

- Vidnoz: Una herramienta que permite crear videos con IA, enfocada principalmente en la generación de videos promocionales o explicativos utilizando rostros y voces artificiales.

Algunos de los usos que ya podemos ver entre nosotros son ejemplos tan impactantes como revivir digitalmente a personas fallecidas. Un ejemplo conocido es MyHeritage, una página que tuvo éxito al permitir a los usuarios crear animaciones de fotos antiguas de sus seres queridos, lo cual generó una mezcla de emociones entre nostalgia y sorpresa.

Imagen: Fotografías falsas o editadas.

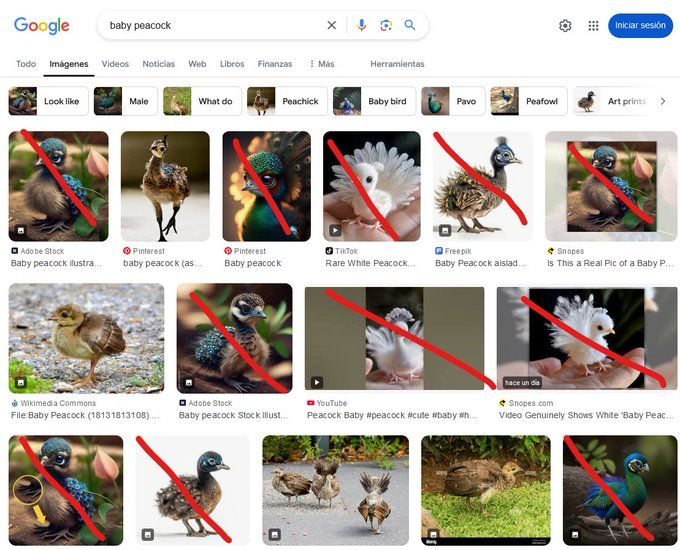

Con IA, se pueden generar imágenes hiperrealistas que son imposibles de distinguir a simple vista, como los pavos reales que Google tuvo dificultad en reconocer como falsos y que se colaron en su muestra de resultados de búsqueda orgánica.

Esta imagen la he extraído del siguiente post de Miren Agirregomezkorta

Texto: Creación de noticias falsas.

Herramientas: Modelos de lenguaje como ChatGPT. La IA puede generar artículos, titulares o información que parezca real, pero que ha sido inventada, contribuyendo a la desinformación.

Mezclar información real con información falsa es una táctica común para crear noticias falsas y desinformar.

Además, la IA también puede capturar el estilo de escritura de una persona para suplantarla, lo cual representa un riesgo considerable en la autenticidad de la información.

Actualmente, existen casos en los que la gente está utilizando estas capacidades avanzadas de modelos de lenguaje para hacer entrevistas de trabajo en tiempo real, con la IA respondiendo en su nombre y ayudando a presentar respuestas más persuasivas o técnicas. Esto plantea preocupaciones éticas sobre la autenticidad de las habilidades y capacidades de los candidatos, así como la legitimidad de estos procesos.

Patrones de ChatGPT para detectar contenido generado por IA: Algunos patrones reconocidos para identificar contenido generado por ChatGPT incluyen frases extremadamente formales, repeticiones de ideas, falta de detalles específicos o uso de construcciones de frases comunes sin errores tipográficos. La capitalización de títulos en español imitando al estilo inglés, las muletillas como crucial…son pequeñas pistas para saber que estamos delante de contenido generado por un LLM, en este caso como GPT, pero no son infalibles.

Ideas Clave: Deepfakes, Desinformación y Manipulación

El Peligro de la Desinformación y los Deepfakes

Uno de los principales usos problemáticos de los deepfakes y el contenido generado por IA es la desinformación. Las fake news (noticias falsas) creadas con IA pueden tener diferentes intenciones como intereses políticos o intereses comerciales: ganar dinero a través de clics sensacionalistas.

La IA aprende de todo lo que está en internet, pero eso significa que también aprende cosas falsas, y no siempre es fácil distinguir entre lo real y lo manipulado.

Las redes sociales, lejos de ser un espacio seguro, se han convertido en una plataforma ideal para la propagación de bulos. Son canales principales para la difusión rápida de información. Los deepfakes pueden manipular emocionalmente a la audiencia con titulares impactantes y diseñados para provocar miedo o ira, lo que lleva a que el contenido se viralice más rápidamente.

Diferencias Entre IA y Creadores Humanos Maliciosos

Existe una diferencia entre el contenido generado por IA y el creado por humanos con malas intenciones. El contenido generado por IA no siempre tiene una intención directa de causar daño; puede ser creado simplemente porque la tecnología lo permite. En cambio, cuando una persona crea noticias falsas, lo hace con el claro propósito de manipular o engañar a la audiencia.

Aplicaciones y Riesgos: ¿Por Qué Preocupan los Deepfakes?

- Promoción de productos y publicidad: Algunas empresas utilizan deepfakes para promocionar productos, a veces usando la imagen de famosos sin su autorización. Por ejemplo, se han creado deepfakes de la presentadora Gayle King para promocionar productos de pérdida de peso.

- Contenido de adulto y chantajes: Los deepfakes también se han utilizado para crear contenido de adultos sin el consentimiento de las personas involucradas. Esto representa un riesgo importante de violación de la privacidad y chantaje, en algunos casos.

- Secuestros falsos y estafas: Imagina recibir una llamada de un familiar que parece real, pero resulta ser una voz clonada usando IA. Esta tecnología se ha utilizado para simular secuestros falsos o para estafar a personas haciéndoles creer que alguien cercano está en peligro.

¿Cómo podemos detectar contenidos falsos?

Aunque la IA se vuelve cada vez más sofisticada, también existen herramientas de detección. Estas se utilizan para identificar si una imagen, audio o video es falso. Sin embargo, no siempre son perfectas. Por ejemplo, algunas herramientas pueden detectar erróneamente fragmentos de textos formales como la Constitución Española como contenido generado por IA.

Lo que parece claro es que estamos entrando en una especie de juego interminable entre tecnologías que buscan crear contenido indetectable y herramientas que intentan desenmascararlo. Una carrera constante entre ambos lados, donde la tecnología de generar y la de detectar están evolucionando sin parar.

Por tanto, el papel de los revisores humanos sigue siendo imprescindible.

Y no solo en la detección de contenido violento o sexual, sino también en la identificación de bulos y deepfakes. Estos moderadores humanos ayudan a verificar la autenticidad de contenido sospechoso y detectar intentos de manipulación que las herramientas automáticas podrían pasar por alto.

Dado que la IA no siempre puede interpretar el contexto, estos revisores aportan la perspectiva humana necesaria para diferenciar entre una sátira, una opinión legítima y una desinformación peligrosa.

Además, la IA tiene dificultades para entender el contexto o la intención de un contenido. Algo que es una broma o una sátira podría ser marcado como falso, aunque no lo sea. Entender el humor y las emociones humanas sigue siendo un reto complejo para las máquinas.

Normativa y Regulación: Mundial, Europea, AESIA, INCIBE y BAIC

Entender la normativa y regulación sobre la inteligencia artificial es fundamental, ya que estas leyes determinan cómo se puede usar la IA de manera segura y ética. La regulación no solo afecta a los desarrolladores y empresas tecnológicas, sino también a los usuarios, ya que establece límites y derechos que nos protegen frente a los posibles abusos de estas tecnologías, como los deepfakes y otras formas de manipulación digital.

La regulación de la inteligencia artificial y las tecnologías relacionadas con los deepfakes es un desafío creciente a nivel global. A continuación, te dejo un resumen de las normativas y esfuerzos regulatorios en diferentes niveles:

Regulación de la Inteligencia Artificial a Nivel Global, Europeo y Nacional

Mundial: En el ámbito internacional, organismos como la ONU han reconocido la necesidad de establecer marcos regulatorios que protejan a los ciudadanos del uso indebido de la IA, incluyendo la creación y difusión de deepfakes. Sin embargo, la coordinación a nivel global es complicada debido a diferencias en las legislaciones y prioridades de cada país.

Europea: La Unión Europea ha tomado un papel de liderazgo en la regulación de la inteligencia artificial. El Reglamento de IA (AI Act), aún en desarrollo, tiene como objetivo establecer límites claros sobre el uso de la IA, clasificar el riesgo de cada aplicación y prohibir ciertos usos que se consideran inaceptables, como los deepfakes que se utilicen para engañar. Además, la UE tiene una estricta normativa sobre privacidad y protección de datos (GDPR) que también abarca el uso de IA en la manipulación de información.

Niveles de riesgo propuestos por la UE:

La regulación europea clasifica los riesgos de la IA en varios niveles:

- Riesgo Inaceptable: Aplicaciones que se consideran peligrosas y están prohibidas, como los sistemas de vigilancia masiva sin justificación o deepfakes que busquen manipular de forma maliciosa.

- Riesgo Alto: Aplicaciones que afectan significativamente los derechos fundamentales, como la IA utilizada en procesos judiciales o en el ámbito de la salud. Estas aplicaciones deben cumplir con estrictos requisitos.

- Riesgo Limitado: Aplicaciones que requieren transparencia, como los chatbots, donde los usuarios deben ser informados de que están interactuando con una IA.

- Riesgo Mínimo: Aplicaciones con poco o ningún impacto adverso, como sistemas de recomendación de productos, donde no se necesitan medidas regulatorias especiales.

Agentes reguladores

AESIA: En España, la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA) se está encargando de supervisar y garantizar el uso seguro y ético de la IA. AESIA tiene la responsabilidad de aplicar la normativa europea en el contexto nacional, estableciendo directrices específicas y colaborando con otras instituciones para proteger a los ciudadanos de riesgos relacionados con deepfakes y la desinformación generada por IA.

INCIBE: El Instituto Nacional de Ciberseguridad (INCIBE) también juega un papel importante en la regulación y protección contra los riesgos de la inteligencia artificial. INCIBE se enfoca en la ciberseguridad y en prevenir el uso malintencionado de tecnologías como los deepfakes, colaborando con AESIA y otras entidades para asegurar un entorno digital más seguro.

BAIC: El Basque Artificial Intelligence Center (BAIC) es otra entidad relevante en el ámbito de la regulación y supervisión de la IA en España. BAIC se centra en el desarrollo ético y responsable de la inteligencia artificial, promoviendo la investigación y la colaboración entre instituciones públicas y privadas para establecer buenas prácticas y estándares que aseguren el uso seguro de estas tecnologías.

Reflexión Final Sobre los Deepfakes y la desinformación

La tecnología puede ser maravillosa y, como diría Arthur C. Clarke: «Cualquier tecnología lo suficientemente avanzada es indistinguible de la magia».

Sin embargo, debemos ser conscientes de los riesgos que conlleva.

La proliferación de deepfakes y contenidos generados por IA nos obliga a ser cada vez más críticos con lo que consumimos y compartimos en internet. Mantenernos informados, utilizar herramientas de detección y contar con revisores humanos son maneras de frenar los riesgos y aprovechar lo mejor de esta tecnología sin caer en sus trampas.

Recordemos que, aunque la IA es poderosa, nosotros, como usuarios responsables, tenemos la última palabra sobre qué creer y qué compartir.

Chao.